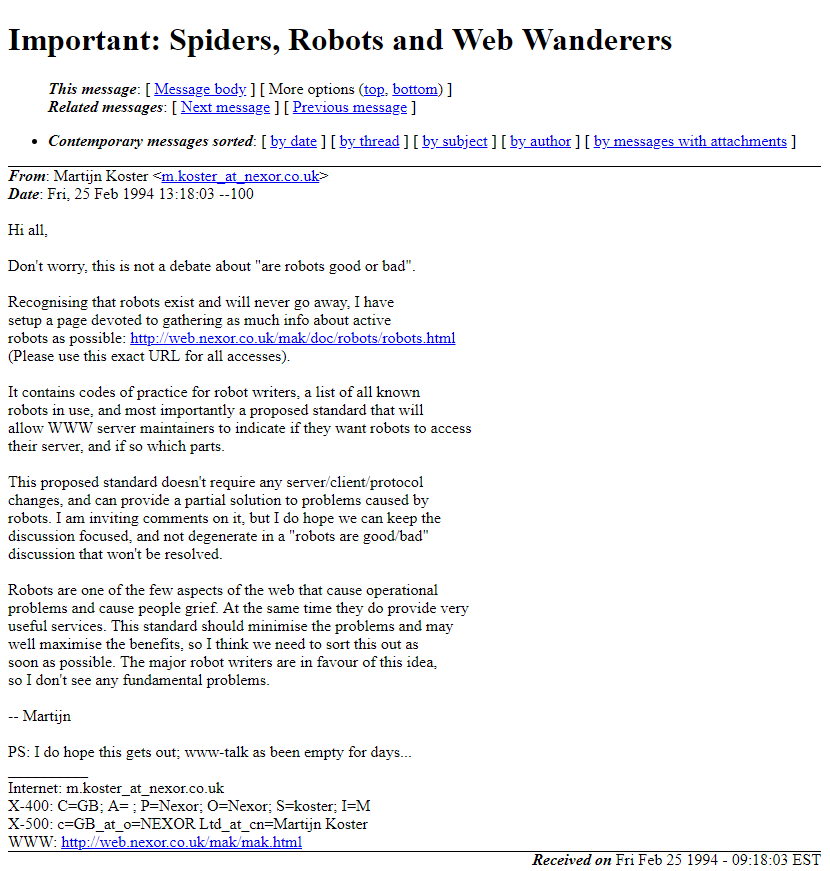

Em 3 de julho de 1994, Martijn Koster, um pesquisador em ciência da computação na Universidade de Nijmegen, na Holanda, apresentou o padrão robots.txt como parte da lista de discussão www-talk da W3C.

Esse padrão foi criado para permitir que os proprietários de sites restrinjam o acesso dos robôs da web a determinadas partes do site, como páginas de login ou informações confidenciais.

O robots.txt é um arquivo de texto simples que indica aos robôs de busca quais páginas de um site podem ser rastreadas e quais devem ser ignoradas.

Ele é colocado na raiz do site e contém instruções para os robôs de busca sobre como eles devem se comportar ao rastrear o site.

O padrão robots.txt se tornou amplamente adotado e é agora uma parte fundamental da arquitetura da web. A maioria dos sites usa o robots.txt para controlar o acesso dos robôs às suas páginas.

Embora o robots.txt não seja uma solução perfeita para todos os problemas de privacidade na web, ele é uma ferramenta importante que ajuda a tornar a web mais segura e protegida.

O Google, em particular, depende fortemente do robots.txt para rastrear a web de forma eficiente.

O Googlebot, o robô de rastreamento do Google, segue as instruções do robots.txt para evitar o rastreamento de áreas não autorizadas de um site.

Isso ajuda a garantir que o Google exiba apenas conteúdo relevante e seguro em seus resultados de pesquisa.

✨ Curtiu este conteúdo?

O GDiscovery está aqui todos os dias trazendo informações confiáveis e independentes sobre o universo Google - e isso só é possível com o apoio de pessoas como você. 🙌

Com apenas R$ 5 por mês, você ajuda a manter este trabalho no ar e leva informação de qualidade para ainda mais gente!