A Meta anunciou o AudioCraft, um framework de inteligência artificial generativa capaz de criar áudio e música a partir de descrições curtas em texto.

A empresa afirma ter avançado consideravelmente na qualidade dos sons gerados por IA, como latidos de cachorro, buzinas de carros e passos em um piso de madeira.

O AudioCraft simplifica o uso de modelos generativos para áudio, fornecendo geradores de som e música, além de algoritmos de compressão, tudo em um único código-fonte.

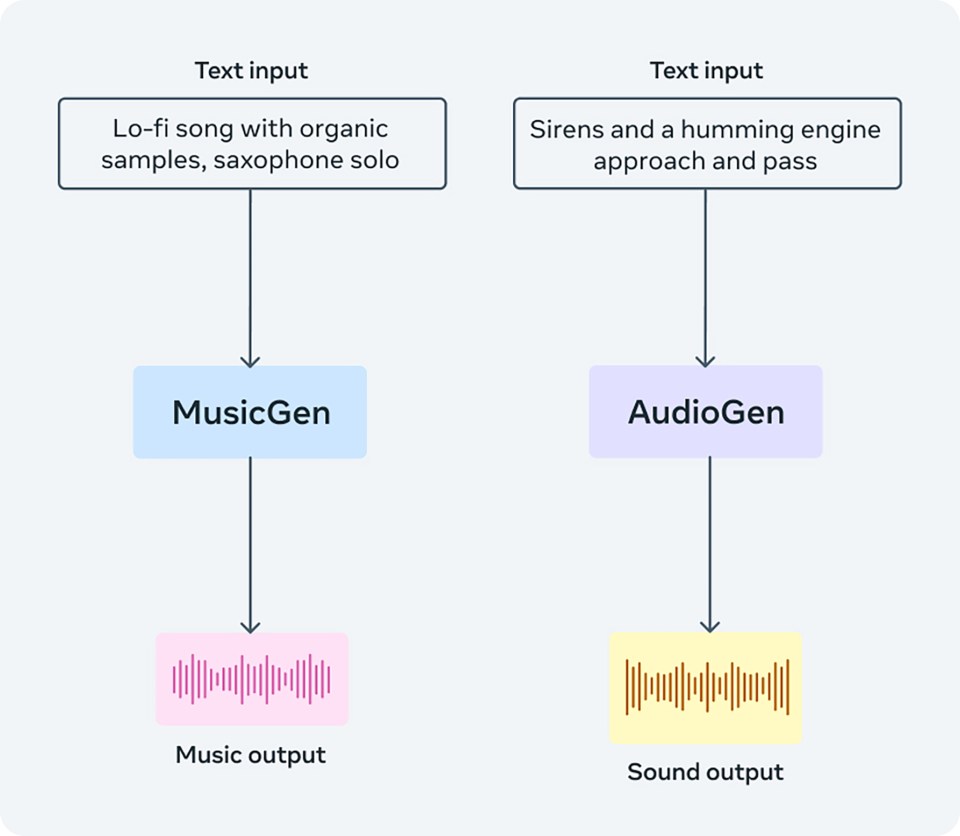

O AudioCraft possui três modelos de IA generativa: MusicGen, AudioGen e EnCodec.

O MusicGen já existia, mas agora a Meta disponibilizou o código de treinamento, permitindo que os usuários treinem o modelo com suas próprias bases de dados musicais.

No entanto, o uso desse modelo para criar músicas semelhantes a obras existentes levanta questões éticas e legais importantes.

O AudioGen, por sua vez, é um modelo focado em gerar sons ambientais e efeitos sonoros realistas, enquanto o EnCodec é um codec neural que comprime e reconstrói sinais de áudio com alta fidelidade.

Apesar das promessas de benefícios e inspiração para músicos, a Meta reconhece os possíveis usos indevidos do AudioCraft, como a criação de deepfakes de vozes e violação de direitos autorais.

A empresa afirma estar trabalhando para melhorar o controle e mitigar as limitações e vieses desses modelos generativos de áudio.

✨ Curtiu este conteúdo?

O GDiscovery está aqui todos os dias trazendo informações confiáveis e independentes sobre o universo Google - e isso só é possível com o apoio de pessoas como você. 🙌

Com apenas R$ 5 por mês, você ajuda a manter este trabalho no ar e leva informação de qualidade para ainda mais gente!