A OpenAI tomou uma iniciativa significativa ao lançar um programa de avaliação para lidar com os riscos catastróficos apresentados pelos modelos de IA mais avançados.

Enquanto muitas preocupações e temores têm sido expressos em relação aos possíveis riscos que esses modelos podem trazer, pouco se discutiu sobre como prevenir esses perigos em potencial.

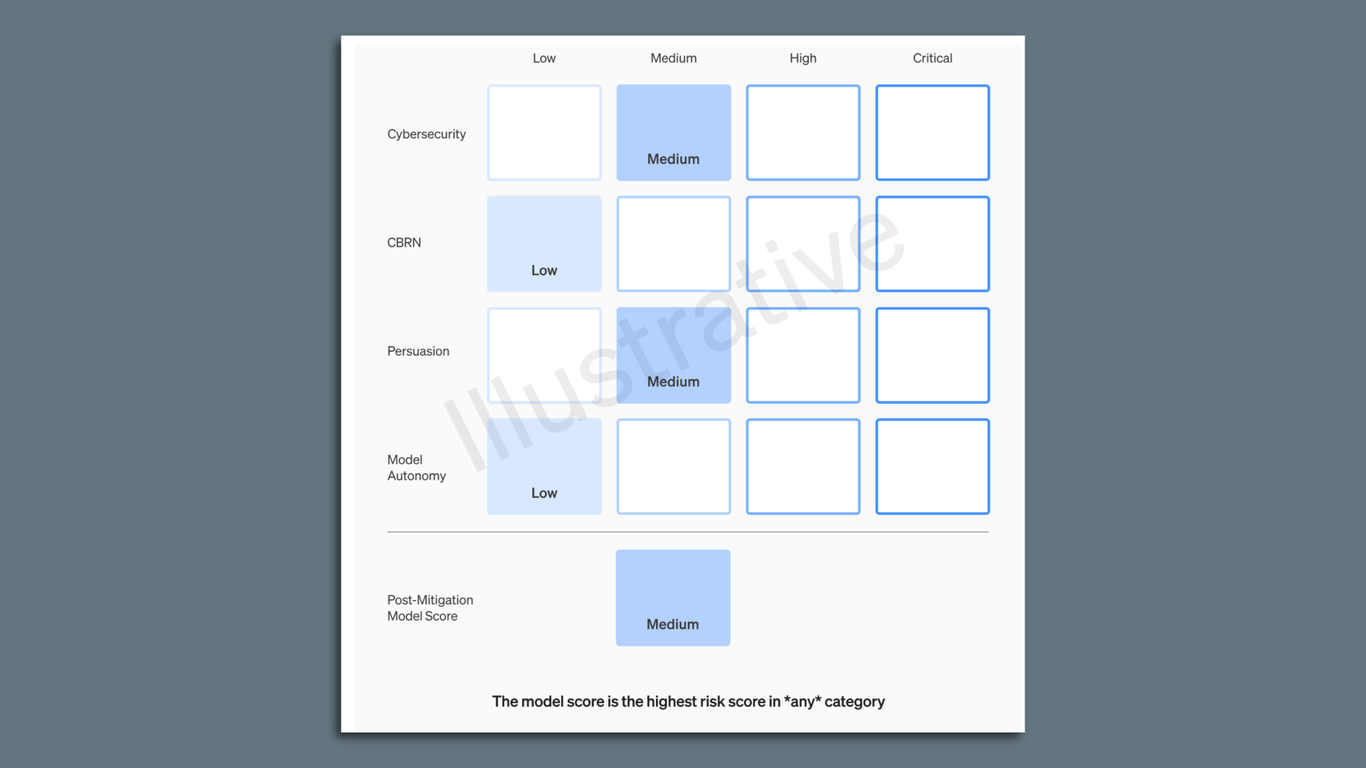

A proposta é utilizar uma abordagem matricial que documenta os níveis de risco associados a esses modelos de última geração.

Dentre os riscos considerados estão a possibilidade de uso malicioso dos modelos para criação de malware, ataques de engenharia social ou disseminação de informações prejudiciais relacionadas a armas nucleares ou biológicas.

A OpenAI pontuará cada risco em categorias como baixo, médio, alto ou crítico, antes e depois de implementar medidas de mitigação específicas para cada categoria.

Essa abordagem garantirá que apenas modelos com pontuações “médias” ou inferiores sejam liberados para uso, enquanto o desenvolvimento de modelos será interrompido caso os riscos não possam ser reduzidos abaixo do nível crítico.

Além disso, a OpenAI está comprometida em fortalecer seus sistemas de governança para evitar eventos que possam comprometer a segurança.

A empresa espera que essa abordagem pioneira para avaliar riscos seja adotada por outras empresas de IA, promovendo uma cultura de segurança e mitigação de riscos em toda a indústria.

✨ Curtiu este conteúdo?

O GDiscovery está aqui todos os dias trazendo informações confiáveis e independentes sobre o universo Google - e isso só é possível com o apoio de pessoas como você. 🙌

Com apenas R$ 5 por mês, você ajuda a manter este trabalho no ar e leva informação de qualidade para ainda mais gente!