Principais destaques:

- Novo algoritmo da Google Research reduz uso de memória em até 6 vezes

- Ganho de desempenho pode chegar a 8 vezes no cálculo de atenção

- Solução funciona sem necessidade de reentreinar modelos como Gemma e Mistral

A Google acaba de apresentar um avanço importante no campo da inteligência artificial. O novo algoritmo TurboQuant promete tornar modelos de linguagem grandes mais leves e rápidos, sem exigir ajustes ou reprocessamento. A inovação chega em um momento em que o alto consumo de memória se tornou um dos principais desafios para escalar aplicações de IA.

Como o TurboQuant consegue comprimir tanto

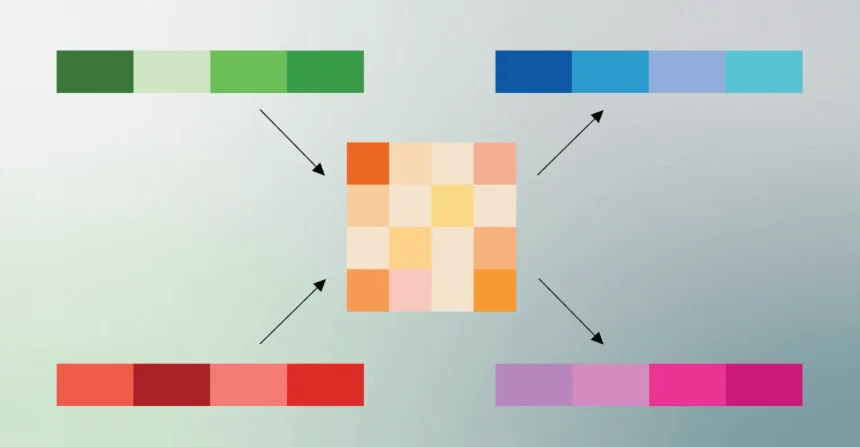

O TurboQuant foi desenvolvido por pesquisadores da Google Research com base em princípios clássicos da teoria da informação. O método funciona em duas etapas complementares.

A primeira, chamada PolarQuant, reorganiza os dados de forma inteligente, convertendo informações em formatos mais compactos sem perder a essência dos dados. Isso elimina a necessidade de armazenar blocos grandes com alta precisão.

Na sequência, entra uma técnica inspirada na transformação Johnson-Lindenstrauss, que corrige pequenas distorções geradas na compressão. O resultado final é um sistema que mantém a qualidade das respostas enquanto reduz drasticamente o espaço necessário.

Desempenho impressiona em testes práticos

Os testes foram realizados em GPUs modernas, como a Nvidia H100, e mostraram resultados expressivos. O TurboQuant atingiu até oito vezes mais velocidade em cálculos de atenção quando comparado ao padrão tradicional de 32 bits.

Além disso, benchmarks amplamente utilizados, como LongBench e ZeroSCROLLS, confirmaram que a qualidade das respostas permanece praticamente intacta, mesmo com compressão agressiva.

Outro destaque foi o desempenho em tarefas de busca semântica, onde o algoritmo superou técnicas anteriores tanto em velocidade quanto em precisão.

Impacto direto na IA em produção

Um dos maiores diferenciais do TurboQuant é sua facilidade de adoção. Por não depender de dados específicos nem exigir reconfiguração dos modelos, ele pode ser integrado diretamente em sistemas já existentes.

Isso abre portas para aplicações mais eficientes em larga escala, desde assistentes virtuais até mecanismos de busca inteligentes. Em ambientes de produção, onde cada ganho de desempenho conta, a redução do tráfego de memória pode representar economia significativa de custos e aumento de capacidade.

O estudo foi inicialmente divulgado no arXiv e será apresentado na ICLR 2026, reforçando a relevância da descoberta para o futuro da inteligência artificial.

✨ Curtiu este conteúdo?

O GDiscovery está aqui todos os dias trazendo informações confiáveis e independentes sobre o universo Google - e isso só é possível com o apoio de pessoas como você. 🙌

Com apenas R$ 5 por mês, você ajuda a manter este trabalho no ar e leva informação de qualidade para ainda mais gente!