O Google Research publicou um estudo em que mostra ter encontrado uma solução inicial para uma complicada questão nas traduções automáticas: a correferência entre os termos.

Em vez de mexer nas redes neurais que hoje são a alma das traduções do Google Tradutor, o Google preferiu incorporar um novo algoritmo que acompanha com muita atenção a tradução final.

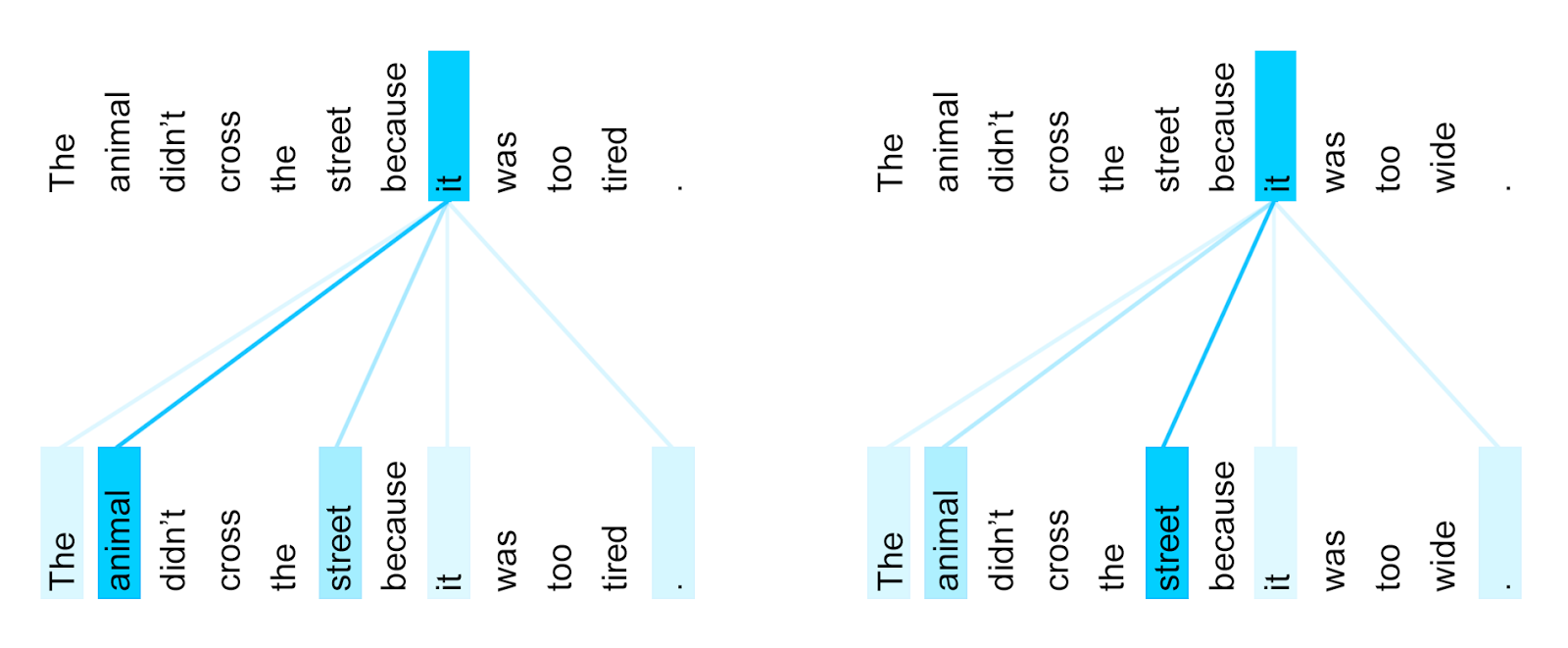

A solução é um mecanismo de atenção, chamado Transformer. Ele compara cada palavra com todas as outras palavras na frase para ver se alguma delas afeta de alguma maneira – para ver se “ele” ou “ela” está falando.

Quando a frase traduzida está sendo construída, o mecanismo de atenção compara cada palavra, uma vez que é anexado a cada uma. Você pode visualizar o processo abaixo:

O Google Transformer também tenta entender a relação existente entre dois ou mais termos para uma melhor análise sintática no final da tradução. Como mostrado abaixo:

✨ Curtiu este conteúdo?

O GDiscovery está aqui todos os dias trazendo informações confiáveis e independentes sobre o universo Google - e isso só é possível com o apoio de pessoas como você. 🙌

Com apenas R$ 5 por mês, você ajuda a manter este trabalho no ar e leva informação de qualidade para ainda mais gente!

Incrível!